美伊冲突评述之十二哈梅内伊:“AI战争时代”的死亡者

作者:赵晓

一、凌晨:一个人被“计算”的时刻

德黑兰北部,凌晨。

没有爆炸声。没有战机轰鸣。甚至没有防空警报。房间里灯光昏黄。厚重窗帘垂落。走廊里安保人员低声交谈。对一位八十多岁的老人来说,这不过是寻常的一夜。但在几千公里之外,屏幕在闪烁。不是一张,是几十张。

冷色调的界面上,一个红点缓慢移动。那不是“人”。那是一个带标签的节点:年龄、安保级别、轨迹偏差、停留时长、电磁信号波动……

系统提示:行为偏离常规模式 3.7%、置信度上升。工程师没有说话,算法已经在运算。

二、死亡前的十分钟:他变成一条轨迹

来自卫星的热成像,来自电子侦察的微弱辐射,来自通信截获的异常片段——被压缩成概率。如果公开报道属实,类似Palantir 的情报整合系统,会把这些碎片拼成一张“共同作战图像”。在那张图上,他不是一个老人。他是一条轨迹。

另一端,类似Claude这样的大模型在处理海量信息。它不愤怒、不崇拜、不仇恨。它只回答一个问题:如果此刻实施电子压制,目标最可能的移动方向是什么?模型吐出概率图。

没有历史讨论、没有意识形态辩论。只有一句话:“窗口期 92 秒。”

三、太空:AI战争的神经系统

当德黑兰切断地面通信,当电磁干扰覆盖城市上空,战争并没有失明。因为战争的“眼睛”,已经“长”在太空。

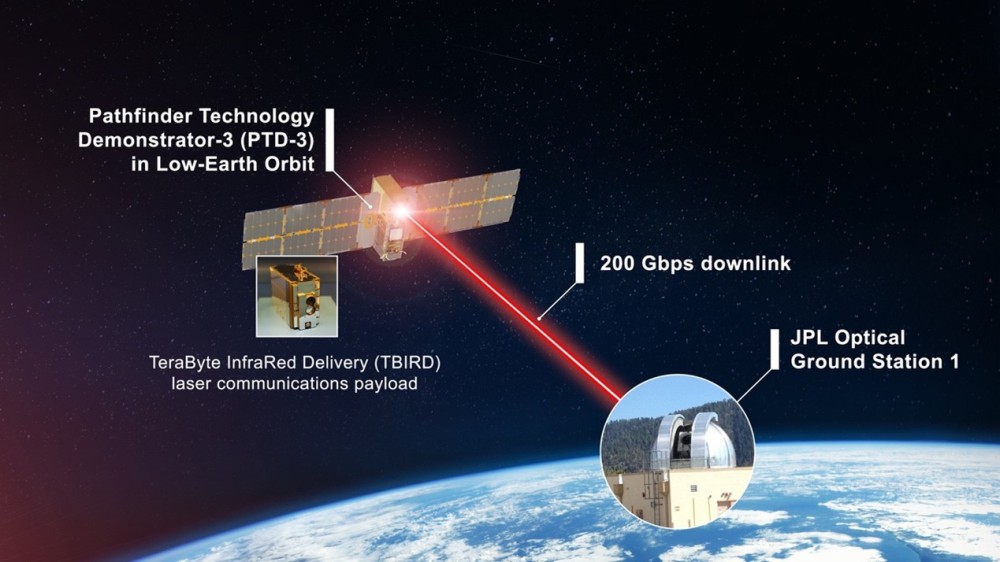

过去,战争依赖:电台、光缆、地面基站。切断它们,战场就会失联。但在AI战争时代,低轨道卫星星座构成了一张不依赖地面基础设施的“数字天空网”。以 SpaceX 为代表的低轨星座系统——包括 Starlink 以及其军用衍生体系 Starshield——让战场数据可以绕开封锁,从地面直达轨道,再通过激光链路在太空中传递。

这意味着什么?意味着——即便一个国家关闭所有互联网,算法仍然可以“看见”,即便电磁干扰铺天盖地,无人机仍然可以接收指令。太空不再只是导航辅助。它成为战争的神经系统。

1. 太空带宽:算法的“氧气”

AI战争需要的不是子弹。是带宽。实时高分辨率图像、多源传感器数据、模型更新参数、无人系统协同指令,这些都必须高速传输。

没有稳定链路,“杀伤链压缩”就会失效。因此,真正支撑“92秒窗口期”的,不是某一枚导弹,而是持续不断的数据流。

2. 地理纵深正在失去意义

传统战争中,纵深意味着安全。山脉、地下掩体、封闭城市,都是屏障。

但当卫星在低轨运行,当星间激光链路绕开国界,地理优势开始被削弱。城市上空没有战机,却有成百上千颗轨道节点。它们沉默。却持续扫描。

3. 权力结构的迁移

更值得关注的,是权力的转移。过去,战争的主导权在军队。后来,在工业能力。现在,正在向——算法能力、数据整合能力、太空基础设施控制权转移。

谁控制星座网络,谁就控制战争的“感知层”。

谁拥有算力与模型,谁就控制战争的“判断层”。

谁掌握自主系统,谁就控制战争的“执行层”。

这是一种新的权力三位一体。

4.星链不是主角,但它是血管

在哈梅内伊之死的叙事中,导弹是画面,算法是逻辑,无人机是执行者。而太空星座,是血管。没有血管,大脑无法运转,四肢无法行动。因此,这不是一次单纯的斩首行动。这是人类历史上第一次,太空、算法与自主武器形成闭环的象征性时刻。

四、真正扣动扳机的是什么?

空中已经有无人机。不是电影里的庞然大物,而是廉价、可消耗、由软件主导的机器。类似Anduril Industries或Shield AI所推动的那种“软件定义武器”。

算法接管队形,系统规避干扰,目标锁定。最后阶段,人类或许仍按下确认键。但他面对的不是一个人。而是一个闪烁的红框。

五、德黑兰那一瞬间

冲击波很短。没有宏大战场,没有壮烈空战,只有玻璃碎裂,灰尘弥漫,脚步声混乱。走廊里有人喊叫,有人冲向房间。那一刻,他不再是“最高领袖”,他只是一个人,呼吸停止。

六、冷与热:算法没有情绪

屏幕那端,有人松气,有人沉默。系统自动记录:Target neutralized.日志更新,数据归档。

没有胜利的情绪,没有道德困惑。但在德黑兰:家属在哭。城市在震动。宗教与政治的情绪开始翻涌。

AI不理解这些。

七、这场死亡真正改变了什么?

这不是第一次“斩首行动”。不同的,是技术方式:传感器→数据融合→模型推演→目标确认→执行单元。

所谓“Kill Chain Compression”(杀伤链压缩),意味着决策时间被压缩到秒级。当确认时间短于人的道德反应时间,战争的心理结构已经完全改变。人类从“判断者”,变成“确认者”。责任开始模糊。

八、他是谁?一个时代的象征

哈梅内伊(Ali Khamenei)代表的是20世纪晚期的神权革命结构。他依赖:物理掩体、严密安保、信息隔离。但AI战争不依赖“接近”,它依赖模式识别:轨迹、频率、异常、关联。在算法世界里,没有象征,只有概率。

九、三只时钟

军事钟:被拨到极快。

经济钟:无人机便宜,因此不怕消耗惊人。

政治钟:却走得最慢。

历史反复证明:斩首并不自动带来秩序。

十、真正的拷问

当战争变成技术问题:谁设定阈值?谁承担误判?谁为附带伤亡负责?谁决定何时停止?AI可以优化“完成”。却无法回答“正当性”。它不会思考:“是否应该?”

十一、一个时代的分水岭

如果这场行动深度依赖AI辅助,那么它标志着一个转折:人类第一次系统性地把“认知—推演—选择”交给机器协助完成。

有人称之为:“软件定义地缘政治”。我更愿意称之为:算法战争到来的时刻。

十二、谁是赢家?

短期赢家是技术优势方。长期赢家,未必。AI可以消除一个人。却无法消除记忆、仇恨与信念。当战争成本下降,克制反而更难。

十三、尾声:被计算的死亡

德黑兰凌晨的那个红点,在屏幕上缓慢移动。它闪烁,它被标记。它被计算。最终,它消失。

日志更新,节点失活,系统归档。在算法世界里,一切都是流程。但问题恰恰隐藏在这里。当一个人可以被完整地转化为数据节点,当生命被压缩为概率模型,当“目标状态”取代“人的死亡”,战争就不仅改变了方式,也触及了灵魂。

技术没有情绪,算法没有愤怒,无人机也没有仇恨。但人类有。正因为人类有,权力才必须受约束。正义才必须有源头。战争才必须被审判。

AI可以压缩杀伤链,回答“是否可以”;却不能回答“是否应该”。卫星可以覆盖天空。却不能定义善恶。

如果人类只剩效率,那么红框将越来越频繁,窗口期将越来越短,确认键将越来越轻。而当确认变得轻,罪责就会变得更加模糊。

因此,真正决定AI战争时代走向的,不是算力,不是星座,不是无人系统,而是——人类是否仍然承认:存在高于算法的秩序,存在高于国家的正义,存在高于技术的审判。

如果承认,那么哪怕红点在屏幕上闪烁,人类仍然会停下来思考。如果不承认,那么下一次红点消失时,消失的将不仅是一个人,而是我们对“人为何不可被任意计算”的信念。

凌晨的红点已经熄灭。问题是——在太空与算法之上,我们是否仍然守望着真光?